×

Im lepsza automatyzacja, tym groźniejszy błąd — błędna oferta wysłana do 500 osób może kosztować ~200 euro. Zasada: ustaw człowieka przed akcją nieodwracalną, policz koszt review (np. 3 minuty) vs oczekiwany koszt błędu i wprowadź próg eskalacji (film: 1000 zł). Loguj strukturalnie powody odrzuceń, ucz system etapowo (2–4 tyg. intensywnego review) i stopniowo zmniejszaj zakres ręcznej kontroli.

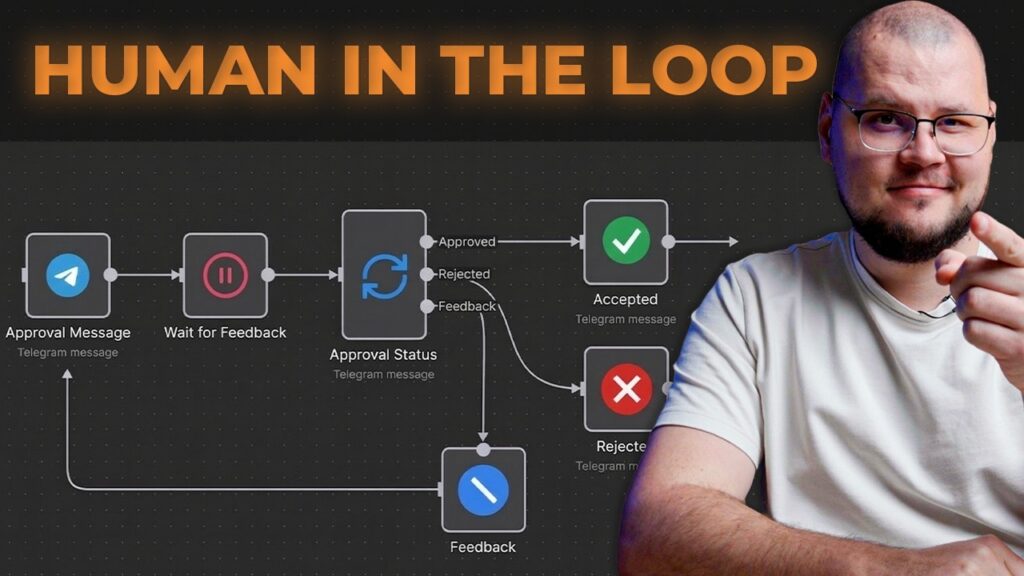

Im lepsza automatyzacja, tym groźniejszy błąd. To brzmi jak paradoks, ale w praktyce właśnie tak działa AI w biznesie. Jeśli agent popełni drobną pomyłkę przy jednym mailu, masz problem operacyjny. Jeśli popełni ją przy 500 mailach, masz już koszt, chaos i problem reputacyjny. W materiale wideo pada prosty przykład: błędna oferta wysłana do 500 osób może wygenerować koszt 200 euro. I to jeszcze wariant optymistyczny, bo nie liczy utraty zaufania.

Dlatego sekret niezawodnych agentów AI nie polega na tym, żeby automatyzować wszystko. Polega na tym, żeby wiedzieć, gdzie postawić człowieka jako ostatnią bramkę bezpieczeństwa. Human in the loop nie jest hamulcem. To bezpiecznik. Taki, który kosztuje mniej niż gaszenie pożaru po źle działającej automatyzacji.

W tym artykule idziemy krok dalej niż samo demo z n8n. Rozłożymy ten model na czynniki pierwsze: kiedy ręczna akceptacja naprawdę ma sens, jak policzyć jej opłacalność, jak ustawić progi decyzyjne i jak potraktować ten proces nie tylko jako kontrolę jakości, ale też jako system treningowy dla agentów. Bo celem nie jest klikanie „akceptuj” do końca życia. Celem jest zbudowanie procesu, który uczy się na błędach szybciej niż je produkuje.

Dlaczego pełna automatyzacja bywa najdroższą pokusą

Wielu freelancerów i właścicieli małych biznesów wpada dziś w tę samą pułapkę. Skoro AI umie pisać, klasyfikować, streszczać i wysyłać, to naturalny odruch brzmi: świetnie, wytnijmy człowieka z procesu. Problem w tym, że model językowy nie rozumie odpowiedzialności biznesowej. Rozumie prawdopodobieństwo kolejnych tokenów. To różnica fundamentalna.

W niskostawkowych zadaniach błąd bywa irytujący. W zadaniach związanych z ofertą, płatnością, komunikacją publiczną albo danymi klienta błąd staje się kosztowny. I właśnie tu human in the loop przestaje być opcją techniczną, a staje się decyzją strategiczną. Tak samo jak nie zatrudniasz księgowego tylko po to, by klikał w systemie, ale po to, by nie narobić sobie kłopotów z urzędem, tak samo nie dodajesz ręcznej akceptacji dla estetyki. Dodajesz ją, by ograniczyć value at risk, czyli wartość ryzyka w jednym przebiegu procesu.

Z perspektywy operacyjnej automatyzacja AI ma jedną cechę, której klasyczne workflow bez modeli nie miały w takiej skali: potrafi wygenerować błąd logicznie spójny, językowo poprawny i kompletnie fałszywy. To właśnie czyni halucynacje tak zdradliwymi. Są jak bardzo pewny siebie praktykant, który mówi płynnie i myli wszystko poza własnym imieniem.

W których miejscach procesu człowiek powinien wejść do gry

Materiał pokazuje to na przykładzie newslettera budowanego w n8n, w którym agent zbiera newsy, sprawdza duplikaty, parsuje treść, przygotowuje draft i wysyła go do akceptacji przez Slacka, a dopiero potem dochodzi do wysyłki przez GetResponse. To dobry wzorzec, bo ręczna akceptacja nie jest wstawiona na ślepo. Pojawia się tuż przed momentem nieodwracalnym.

I to jest zasada, którą warto przenieść na inne procesy. Człowiek powinien pojawić się nie tam, gdzie proces jest najbardziej skomplikowany technicznie, ale tam, gdzie koszt pomyłki po wdrożeniu jest najwyższy. W praktyce najczęściej dotyczy to ofert handlowych, wiadomości do klientów, publikacji pod marką osobistą, decyzji finansowych, zmian w bazie kontaktów i automatycznych odpowiedzi, które mogą wywołać skutki prawne albo sprzedażowe.

- Niski priorytet dla ręcznej akceptacji: tagowanie leadów, porządkowanie notatek, klasyfikacja zapytań, wstępne szkice wewnętrzne, research do dalszej pracy.

- Wysoki priorytet dla ręcznej akceptacji: wyceny, oferty, wiadomości sprzedażowe, newslettery, publikacje publiczne, decyzje płatnicze, odpowiedzi do klientów strategicznych.

Ten podział warto doprecyzować własnymi progami. W wideo pojawia się czytelna reguła biznesowa: jeśli wartość oferty przekracza 1000 zł, wymagana jest zgoda człowieka; jeśli jest niższa, system może automatycznie podziękować lub odrzucić. To bardzo sensowny kierunek. Nie dlatego, że 1000 zł to magiczna granica, ale dlatego, że każda automatyzacja potrzebuje progu eskalacji. Bez niego proces jest albo zbyt ryzykowny, albo zbyt ciężki operacyjnie.

Zanim ustawisz próg ręcznej akceptacji, warto policzyć koszty, ryzyko i czarny scenariusz. To pozwala ustalić, kiedy kontrola człowieka naprawdę się opłaca, a kiedy tylko spowalnia proces.

Kliknij, aby przeczytać artykuł: #3 – Policz kasę, załóż czarny scenariusz i napisz biznes plan

Jak policzyć, czy human in the loop się opłaca

Tu zaczyna się część, której zwykle brakuje w dyskusjach o AI. Sam fakt, że ręczna akceptacja zwiększa bezpieczeństwo, jeszcze nie oznacza, że jest wdrożona dobrze. Trzeba policzyć jej koszt jednostkowy i porównać go z kosztem potencjalnej pomyłki.

Najprostszy model wygląda tak: koszt review człowieka na jeden przypadek kontra oczekiwany koszt błędu bez review. Jeśli reviewer poświęca 3 minuty na akceptację wiadomości, a jego stawka robocza wynosi przykładowo kilkadziesiąt złotych za godzinę, możesz łatwo wyliczyć koszt kontroli jednej operacji. Potem porównujesz go z ryzykiem. Jeżeli jeden błąd może wysłać złą ofertę do setek odbiorców, koszt ręcznej akceptacji bardzo szybko zaczyna wyglądać jak tanie ubezpieczenie.

Przy wycenie pracy pomocniczej warto też pamiętać, że na rynku istnieją usługi, które mają już konkretne widełki. W materiałach GeekWork pojawiają się na przykład wyceny projektów automatyzacyjnych rzędu 2000–2500 zł za projekt oraz przykłady prostszych usług rozliczanych stałą stawką, co daje punkt odniesienia do szacowania wartości czasu operacyjnego i kosztu obsługi procesu. Źródło: GeekWork, „5 sprawdzonych sposobów na dorobienie nawet 3500 zł” [https://geekwork.pl/side-hustle/].

Strategicznie najlepiej działa podejście etapowe. Przez pierwszy miesiąc każda krytyczna operacja przechodzi przez człowieka. Następnie analizujesz: ile było błędów, jakiego typu, na jakim etapie się pojawiały i które da się zneutralizować lepszym promptem, walidacją danych albo dodatkowym warunkiem w workflow. Innymi słowy, człowiek nie tylko zatwierdza. Człowiek generuje dane treningowe do optymalizacji procesu.

Architektura procesu w n8n: co warto dodać poza samym demo

Sam schemat z filmu jest sensowny: trigger uruchamiany trzy razy w tygodniu, sprawdzenie bazy pod kątem duplikatów, agent zbierający informacje, parsowanie, moderator AI, wysyłka draftu na Slacka, decyzja człowieka, finalizacja, przekazanie do GetResponse i potwierdzenie wysyłki. Ale jeśli chcesz, żeby to działało produkcyjnie, a nie tylko efektownie na ekranie, potrzebujesz jeszcze kilku warstw zabezpieczeń.

Pierwsza to walidacja wejścia. Zanim model zacznie pisać, dane powinny przejść przez reguły twarde: czy źródło istnieje, czy rekord nie był już przetwarzany, czy pola obowiązkowe są wypełnione, czy link zwraca poprawny status. Druga warstwa to walidacja wyjścia: długość treści, obecność wymaganych sekcji, zgodność z formatem, brak zakazanych sformułowań, zgodność z tonem marki. Trzecia warstwa to logowanie decyzji. Jeśli człowiek odrzuca draft, system powinien zapisać powód odrzucenia w sposób strukturalny, nie tylko jako komentarz w Slacku.

W praktyce oznacza to, że Slack nie powinien być wyłącznie skrzynką powiadomień. Powinien być interfejsem decyzyjnym. Dobra implementacja zapisuje co najmniej: identyfikator przebiegu, wersję draftu, status decyzji, czas reakcji, powód korekty oraz finalny wynik. Dopiero z takich danych można później wyciągnąć wnioski, które elementy promptu są słabe, które źródła generują najwięcej śmieci i które typy zadań można bezpiecznie odblokować do pełnej automatyzacji.

Jeśli chcesz lepiej dobrać stos narzędzi i zrozumieć, gdzie kończy się wygoda, a zaczyna bezpieczeństwo danych, ten materiał dobrze uzupełnia temat integracji AI z automatyzacją.

GetResponse, ActiveCampaign i lekcja z marketing automation

Choć w filmie pojawia się GetResponse, sam wzorzec jest szerszy i dobrze znany z systemów klasy marketing automation. Najważniejsza lekcja brzmi: wysyłka to nie koniec procesu, tylko kolejny punkt kontrolny. Jeśli integrujesz n8n z narzędziem mailingowym, warto przewidzieć nie tylko wysłanie kampanii, ale też odbiór statusu operacji, mapowanie pól kontaktu, obsługę błędów oraz mechanizm rollbacku tam, gdzie to możliwe.

To szczególnie ważne przy pracy z bazą kontaktów. Jeden zły mapping pola potrafi zepsuć segmentację szybciej niż najbardziej kreatywna halucynacja modelu. Dlatego dobra praktyka to osobne środowisko testowe, próbki na małej grupie oraz checklisty przed wysyłką masową. W systemach do automatyzacji marketingu to nie jest fanaberia. To higiena procesu.

Warto też kopiować wzorce z dojrzałych platform. Artykuł o ActiveCampaign dobrze pokazuje logikę mapowania kontaktów, sekwencji i warunków automatyzacyjnych, które można przenieść na inne narzędzia, w tym GetResponse. Źródło: GeekWork, „ActiveCampaign – narzędzie do skutecznej automatyzacji marketingu online” [https://geekwork.pl/activecampaign-narzedzie-do-skutecznej-automatyzacji-marketingu-online/].

Human in the loop jako system uczenia, a nie wieczna proteza

Największy błąd we wdrażaniu tego modelu polega na traktowaniu go jako stałego ręcznego obowiązku. Jeśli po trzech miesiącach nadal zatwierdzasz wszystko tak samo, to znaczy, że proces nie uczy się niczego. A skoro się nie uczy, to automatyzacja jest tylko ładniej ubranym chaosem.

Dojrzały model wygląda inaczej. Najpierw wprowadzasz szeroką kontrolę człowieka. Potem grupujesz błędy. Następnie eliminujesz te, które da się zamknąć regułą. Kolejny etap to aktualizacja promptów i danych wejściowych. Na końcu obniżasz liczbę przypadków wymagających ręcznej akceptacji, ale tylko tam, gdzie wskaźnik błędów rzeczywiście spadł. To trochę jak szkolenie nowego pracownika. Na początku sprawdzasz wszystko. Później tylko to, co nadal ma tendencję do wybuchania.

Warto w tym miejscu ustalić własne KPI procesu. Na przykład: odsetek draftów zaakceptowanych bez zmian, średni czas akceptacji, liczba odrzuceń na 100 uruchomień, liczba błędów krytycznych, liczba błędów powracających oraz procent zadań przeniesionych z trybu manualnego do autonomicznego. Nie trzeba mieć korporacyjnego dashboardu za milion monet. Wystarczy, że dane są spójne i regularnie przeglądane.

Jeśli myślisz o automatyzacjach także jako o usłudze dla klientów, przyda Ci się kontekst wyceny i opłacalności takich wdrożeń. To pomaga lepiej rozmawiać o budżecie, zakresie i realnym zwrocie z projektu.

Kliknij, aby przeczytać artykuł: 5 sprawdzonych sposobów na dorobienie nawet 3500 zł

Najczęstsze błędy przy wdrażaniu człowieka w pętli

Po pierwsze, firmy dodają akceptację zbyt wcześnie albo zbyt późno. Jeśli człowiek zatwierdza surowe dane, to marnuje czas. Jeśli akceptuje już po wysyłce lub po wykonaniu nieodwracalnej akcji, to nie jest human in the loop, tylko human after disaster. Po drugie, brak jasnych kryteriów decyzji sprawia, że reviewer klika intuicyjnie. A intuicja jest świetna do wyboru kawy, ale słaba do standaryzacji procesu.

Po trzecie, wiele zespołów nie zapisuje feedbacku w sposób użyteczny. Głosówka „to brzmi dziwnie” nie pomoże modelowi ani workflow. Dużo lepiej działa klasyfikacja przyczyny odrzucenia: błąd faktograficzny, zły ton, zduplikowany temat, zła segmentacja, niedozwolona obietnica, brak zgodności z ofertą. Dopiero wtedy masz materiał do iteracji.

Po czwarte, zbyt mało uwagi poświęca się warstwie technicznej. Automatyzacja postawiona na własnym VPS i n8n daje sporą kontrolę, ale wymaga też odpowiedzialności za aktualizacje, backupy, logi i uprawnienia. Jeśli korzystasz z hostowanego środowiska albo własnej instalacji na VPS, pamiętaj, że niezawodność procesu nie kończy się na promptach. Awaria node’a, timeout API lub brak retry policy potrafią rozłożyć nawet najlepiej wymyśloną logikę.

FAQ

Czy human in the loop nie zabija oszczędności czasu?

Nie, jeśli jest ustawiony selektywnie. Celem nie jest ręczne zatwierdzanie wszystkiego, ale tylko tych operacji, których błąd jest droższy niż kontrola.

Jak długo trzymać ręczną akceptację w procesie?

Najczęściej warto zacząć od 2 do 4 tygodni intensywnego review i na podstawie danych stopniowo zawężać zakres przypadków wymagających zgody człowieka.

Jakie zadania najlepiej automatyzować bez udziału człowieka?

Te, które mają niski koszt błędu i dają się łatwo odwrócić: klasyfikacja, tagowanie, szkice robocze, research wewnętrzny, porządkowanie danych.

Czy próg 1000 zł z filmu to dobra praktyka dla każdego?

Nie. To przykład reguły biznesowej. Własny próg powinien wynikać z marży, kosztu błędu, wolumenu operacji i tolerancji ryzyka w danym biznesie.

Slack wystarczy jako panel akceptacji?

Na start tak, ale warto zadbać o zapis decyzji w bazie danych albo arkuszu, żeby później dało się analizować odrzucenia i poprawiać proces.

Czy taki model ma sens w jednoosobowej działalności?

Tak, szczególnie u freelancerów i twórców. To właśnie w małych biznesach jeden publiczny błąd potrafi boleć bardziej niż w dużej organizacji z warstwą PR.

Plan implementacji: od efektownej automatyzacji do procesu, który dowozi

Najlepsze automatyzacje AI nie są w pełni autonomiczne. Są dobrze zarządzane. Human in the loop to nie oznaka słabości systemu, tylko dowód dojrzałości właściciela procesu. Jeśli umiesz wskazać miejsca wysokiego ryzyka, policzyć koszt błędu i zamienić ręczny feedback w dane do optymalizacji, budujesz przewagę, a nie tylko kolejny eksperyment z API.

W praktyce wygrywa nie ten, kto zautomatyzuje najwięcej, ale ten, kto potrafi zautomatyzować bez kompromitacji. Agent AI ma działać jak dobry operator, a nie jak stażysta po trzech espresso i bez nadzoru. Dobrze ustawiony człowiek w pętli sprawia, że automatyzacja przestaje być hazardem, a staje się procesem biznesowym.

- Ręczna akceptacja powinna pojawiać się przed działaniami nieodwracalnymi i kosztownymi.

- Opłacalność human in the loop liczy się przez porównanie kosztu review z oczekiwanym kosztem błędu.

- Slack lub podobne narzędzie powinno pełnić rolę interfejsu decyzyjnego, a nie tylko powiadomienia.

- Feedback człowieka trzeba zapisywać strukturalnie, żeby proces dało się później ulepszać.

- Celem jest stopniowe zmniejszanie zakresu ręcznej kontroli tam, gdzie dane potwierdzają bezpieczeństwo.

Next Step: wybierz jedną swoją automatyzację i zaznacz w niej jeden punkt, w którym błąd byłby najdroższy. Właśnie tam dodaj ręczną akceptację albo próg eskalacji jeszcze dziś. A u Ciebie który proces najbardziej potrzebuje teraz człowieka w pętli?